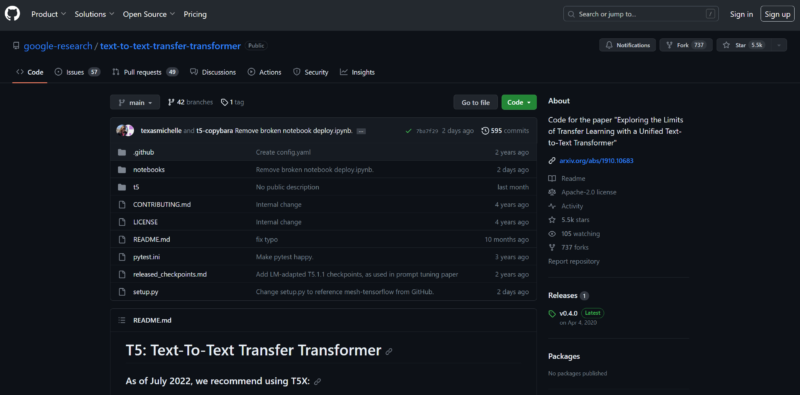

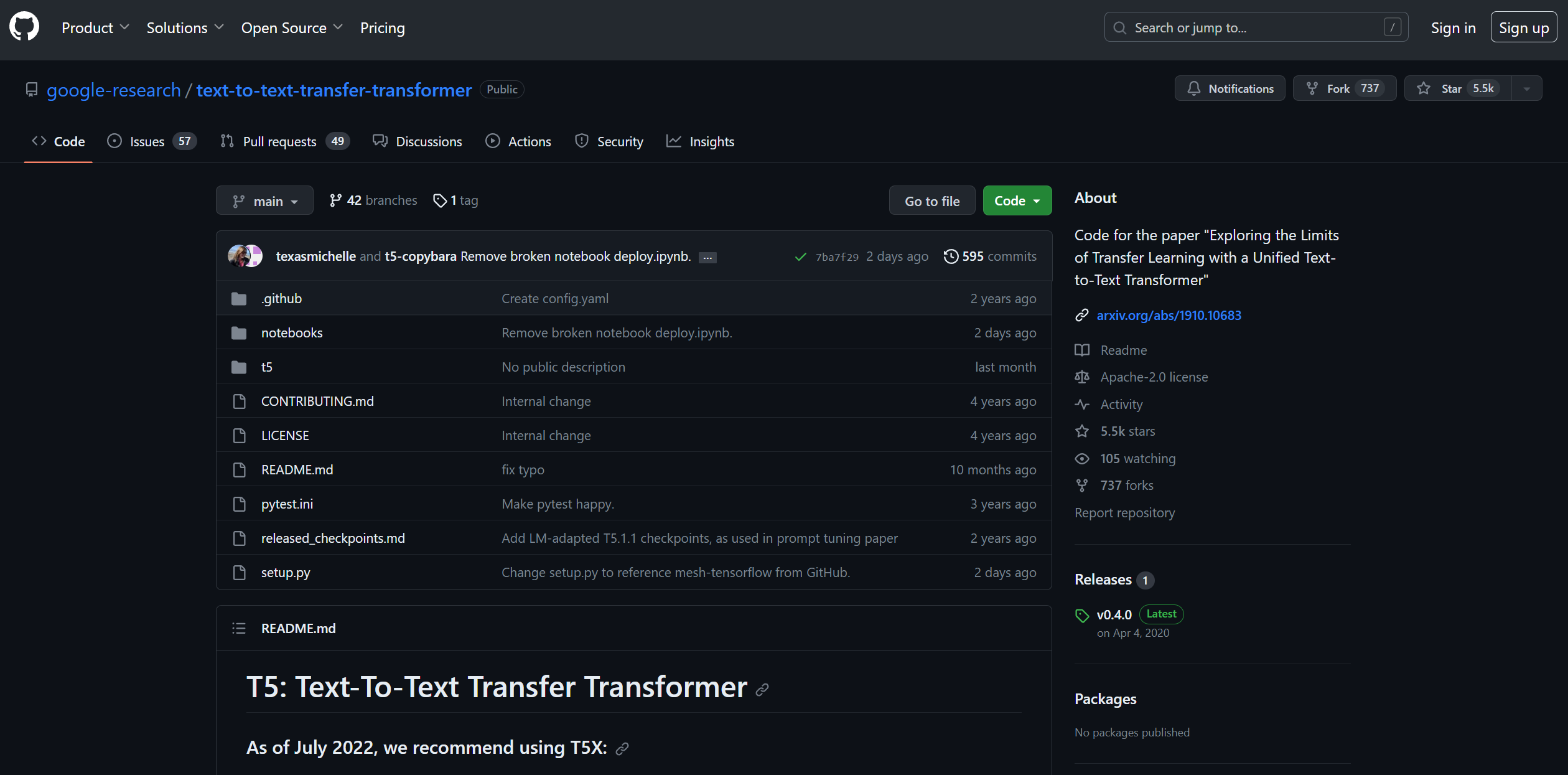

Трансформатор передачи текста в текст (T5)

это продукт Google Research, разработанный для изучения возможностей трансферного обучения. Это унифицированный трансформатор, предварительно обученный на большом корпусе текстов, который может быть использован для достижения современных результатов в различных задачах НЛП. Библиотека T5 служит кодом для воспроизведения экспериментов, описанных в статье проекта, а также может быть использована для разработки будущих моделей, предоставляя полезные модули для обучения и тонкой настройки моделей на смесях задач “текст-текст”.

Ключевые особенности:

t5.data:

Пакет для определения объектов Task, которые предоставляют tf.data.Datasets.

t5.evaluation:

Содержит метрики, которые будут использоваться во время оценки, и утилиты для применения этих метрик во время оценки.

t5.models:

Содержит фиксы для подключения T5-задач и смесей к реализации модели для обучения, оценки и вывода.

Использование:

Подготовка данных:

Поддерживаются задачи, TfdsTasks, TextLineTasks и TSV-файлы.

Установка:

Можно установить с помощью pip.

Настройка TPU на GCP:

Требуется настройка переменных, основанных на вашем проекте, зоне и GCS bucket.

Обучение, тонкая настройка, оценка, декодирование, экспорт:

Для этих операций предусмотрено несколько команд.

Использование GPU:

Поддерживает использование GPU.

Примеры использования:

Воспроизведение экспериментов:

Библиотека T5 может быть использована для воспроизведения экспериментов, описанных в статье проекта.

Разработка моделей:

Библиотека также может быть использована для разработки будущих моделей, предоставляя полезные модули для обучения и тонкой настройки моделей на смесях задач “текст-текст”.

Код T5 имеет открытый исходный код и доступен на GitHub под лицензией Apache-2.0.